- توضیحات

- نوشته شده توسط سئو هکر

ابزار Googlebot اکنون روی آخرین نسخه از کروم اجرا شده و محتوای جاوا اسکریپت سریعتر از همیشه ایندکس میشود. درواقع امروز گوگل چالش کمتری در ایندکس کردن این کدهای پرطرفدار دارد و شرایط درحال بهبود است. متخصصان بهینهسازی موتورهای جستوجو، همیشه با کدهای جاوا اسکریپت مشکل داشتند و گوگل چالشهای زیادی را در رتبهبندی وبسایتهایشان ایجاد میکرد. اگرچه شرایط برای این نوع از محتوا درحال بهتر شدن است، هنوز چالشهایی در مسیر وجود دارند. تأخیر در ایندکس کردن کدهای جاوا اسکریپت هنوز برای موتور جستوجو مشکل بزرگی محسوب میشود.

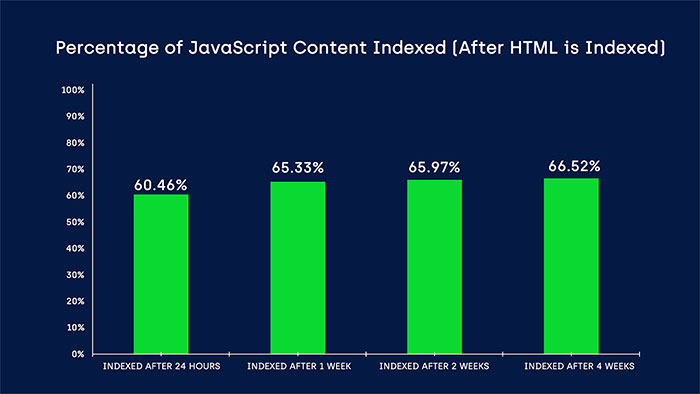

مقالههای مرتبط: تأخیر در ایندکس جاوا اسکریپتایندکس کردن جاوا اسکریپت در گوگل همیشه با تأخیر همراه میشود. گوگل منابع کافی برای ایندکس کدها را دارد، اما بههرحال تأخیری در روند مذکور وجود دارد. این تأخیر چه مقدار زمان میبرد؟ نمودار زیر، نمایشی کلی از زمان مورد نیاز برای ایندکس کردن جاوا اسکریپت را نشان میدهد.

خبر خوب اینکه امروز گوگل با سرعتی مناسب، جاوا اسکریپت را ایندکس میکند. حدود ۶۰ درصد از کدهای جاوا اسکریپت در ۲۴ ساعت اول پس از ایندکس شدن HTML ایندکس میشوند. البته خبر بد هم در این شرایط وجود دارد. ۳۲ درصد از صفحههای بررسیشده برای نمودار بالا، پس از گذشت یک ماه هنوز محتوای جاوا اسکریپت ایندکس نشده دارند که دلایل متعددی دارد. به جدول زیر دقت کنید:

وبسایت موضوع ابعاد نمونه آدرس URL درصد صفحههای دارای جاوا اسکریپت که پس از یک ماه ایندکس شدهاند (۱۰۰ درصد، تعداد صفحههای ایندکس شده) NBC News اخبار / مقاله ۸۰۴ ۲/۷۵ درصد HM تجارت الکترونیک ۶۴۱ ۳۵/۶۹ درصد The Guardian اخبار / مقاله ۳۱۰۰ ۳۹/۹۷ درصد WSJ اخبار / مقاله ۲۷۹۰ ۹۹/۸۲ درصد New York Post اخبار / مقاله ۱۱۴۳ ۱۰۰ درصد Telegraph اخبار / مقاله ۱۰۹۴ ۱۰۰ درصد Gap.com تجارت الکترونیک ۲۳۱ ۱۰۰ درصد زمان انتظار برای ایندکس شدن محتوای جاوا اسکریپت توسط گوگلزمانیکه طول میکشد تا گوگل، محتوای جاوا اسکریپت یک وبسایت را ایندکس کند، وابستگی زیادی به وبسایت، ساختار آن و نوع محتوای جاوا اسکریپت دارد. در جدول زیر، مقایسهی برخی از وبسایتها را مشاهده میکنید:

وبسایت تأخیر میانگین در ایندکس شدن محتوای جاوا اسکریپت (hh:mm:ss) Gap.com ۰۰:۰۰:۰۰ NYPost ۰۰:۱۴:۳۸ Reuters ۰۰:۲۸:۱۱ Trustpilot ۱۰:۵۳:۳۵ HM ۱۹:۲۲:۳۰ DailyStar ۲۰:۱۷:۱۵ TheGuardian ۲۱:۰۵:۵۷ Marketwatch ۲۴:۳۷:۳۵ NBCNews ۳۱:۱۸:۵۰ Showpo ۹۰:۴۳:۴۸در جدول بالا میبینید که گوگل در ایندکس کردن محتوای برخی وبسایتها چالش زیادی ندارد، اما برخی دیگر با فاصله و ظاهرا چالشهای بسیار، ایندکس میشوند. بهعلاوه نمیتوان ادعا کرد که گوگل برای ایندکس کردن محتوای جاوا اسکریپت، وبسایتهای جدید را به رقبای قدیمی ترجیح میدهد.

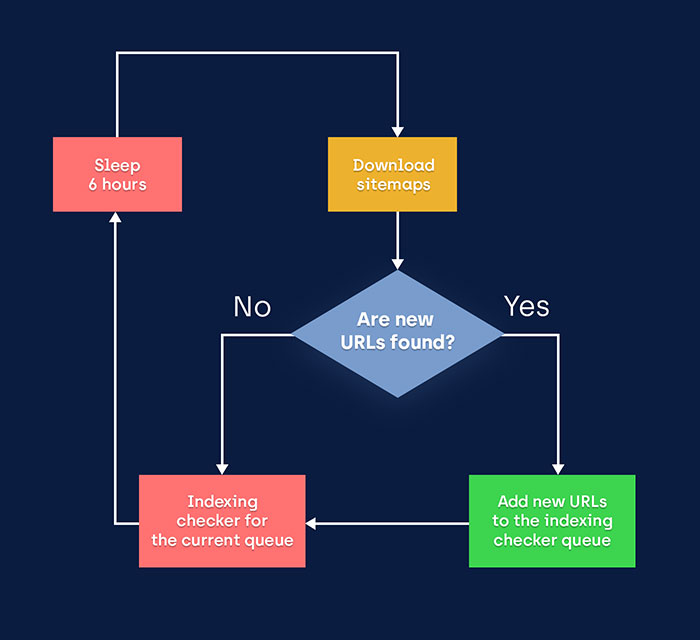

برای بهدست آوردن دادههای بالا، از الگوریتمی برای آزمایش ایندکس جاوا اسکریپت توسط وبسایتها استفاده شد. TGIF یا The Google Indexing Forecast ابزاری است که برای این منظور استفاده شد و روند کاری سادهای دارد:

نمونهای شامل بیش از ۵۰ وبسایت مشهور آماده و سایتمپ آنها برای بررسی صفحههای جدید بهصورت روزانه بررسی شد. بهعنوان نمونهای در این فهرست میتوان به وبسایتهایی همچون T-Mobileو Reuters و TrustPilot اشاره کرد. همهی صفحات جدید بررسی شدند تا ایندکس شدن آنها و ایندکس شدن محتوای جاوا اسکریپت تحلیل شود. در فلوچارت زیر میتوانید روال کلی بررسی ایندکس را مشاهده کنید.

تصور کنید که یک وبسایت جدید در موضوع اخبار راهاندازی کردهاید و محتوای جاوا اسکریپت، تزریق آن را انجام میدهد. اگر گوگل اخبار شما را مثلا ۳۰ ساعت بعد ایندکس کند (که دور از انتظار نیست) دیگر محتوای منتشرشده حکم خبر را ندارد و بسیاری از مخاطبان را از دست میدهید. بهعلاوه اگر جاوا اسکریپت موجود در وبسایت برای ساخت لینک به مطالب مشابه استفاده شود، شرایط دشوارتر هم میشود.

تأخیر در ایندکس کردن باعث میشود که گوگل زمان بیشتری را برای کشف صفحاتی اختصاص دهد که بهتازگی به وبسایت شما افزوده شدهاند. حال تصور کنید که وبسایتی با موضوع تجارت الکترونیک و در حوزهای با رقابت شدید دارید. رقبا نیز همان محصولات وبسایت شما را با نام و توضیحات مشابه منتشر میکنند. دراینمیان وبسایتهایی که با سرعت بیشتری ایندکس شوند، در نتایج بالاتر جستوجو قرار میگیرند. درنتیجه زمانیکه گوگل تلاش میکند صفحات پر از جاوا اسکریپت محصولات شما را ایندکس کند، رقبا رتبههای بالای گوگل را تصاحب کردهاند.

تأخیر در ایندکس جاوا اسکریپت میتواند به قیمت از دست دادن رتبههای برتر در گوگل تمام شودگوگل تلاش میکند تا تنوعی از محتوای مفید را در نتایج جستوجو نشان دهد. با رقابت شدید تجارت الکترونیک در دوران کنونی، قرار گرفتن در نتایج بالایی بسیار دشوار است و شاید تنها با خرید تبلیغات گوگل بتوان در رتبههای بالا قرار گرفت. بههرحال سرعت ایندکس شدن در پیروزی رتبههای برتر گوگل تنها در حوزهی تجارت الکترونیک و اخبار مهم نیست و بسیاری وبسایتهای دیگر ازجمله وبسایتهای مدیریت رویداد، کاریابی و آگهیهای آنلاین نیز به آن نیاز دارند. درنهایت هر وبسایتی که محتوای جدید بسیار تولید کرده و مدام تغییر میکند، باید نگران تأخیر در ایندکس جاوا اسکریپت باشد.

بررسی تصادفی وبسایتهای متعدد در حوزههای خبری و تجارت الکترونیک نشان میدهد که گوگل ۲۵ درصد از محتوای جاوا اسکریپت را در صفحات آن وبسایتها ایندکس نمیکند. چنین مشکلی بهخاطر ایندکس کردن بهصورت دو مرحله یا دو موج ایندکس رخ میدهد. البته عدم ایندکس در موج دوم به دلایل گوناگون رخ میدهد و شاید در برخی نمونهها اصلا اتفاق نیفتد.

مدیران وبسایت و کارشناسان بهینهسازی موتور جستوجو برای رفع چالش ایندکس ابتدا باید متوجه شوند که کدام بخش از محتوای وبسایتشان توسط جاوا اسکریپت تولید میشود. برای این منظور ابزارهای گوناگونی وجود دارد که از میان آنها میتوان به WWJD اشاره کرد. بههرحال پس از کشف تأخیر در ایندکس یا عدم ایندکس بهصورت کلی، باید بهدنبال دلیل آن باشید و راهحلی برای چالش پیشآمده پیدا کنید. شاید مشکل ایندکس، در کدنویسی جاوا اسکریپت باشد یا برخی از رویکردهای SEO قبلی شما مانع از ایندکس صحیح شوند.

درنهایت اگر از جاوا اسکریپت برای تولید محتوا استفاده میکنید، باید رویکردی هوشمندانه برای آن داشته باشید. کنترل کدهای جاوا اسکریپت و نحوهی اجرای آنها در بخشهای گوناگون وبسایت باید توسط مدیر و متخصص SEO و پشتیبان فنی بهصورت مرتب انجام شود. هرگونه کاهش رتبه در نتایج جستوجو را جدی بگیرید و بهدنبال ایراد آن در بخشهای جاوا اسکریپت و کدهای مشابه باشید. فراموش نکنید که رها کردن کدهای جاوا اسکریپت مانند رها کردن فرمان خودرو در سرعت بسیار بالا است.

- توضیحات

- نوشته شده توسط سئو هکر

یک تصور غلطی که در بین سئو کارها وجود دارد این است که هر چه تعداد صفحات مربوط به یک کلمه کلیدی بیشتر باشد، در آن کلمه کلیدی بهتر رتبه خواهید گرفت. تصور می شود هر چه تعدادصفحات بیشتری برای یک کلمه کلیدی درست شود، نتایج آن در موتورهای جستجو بیشتر خواهد بود. اما این تصور کاملا اشتباه است.

در حقیقت هدف قرار دادن یک کلمه کلیدی در چند صفحه مختلف همیشه تاثیر معکوس بر روی نتایج داشته است و با این کار بیشتر به ضرر سئو وب سایت خود عمل می کنید تا اینکه به آن کمک کنید.

علت این مسئله کاملا ساده است: زمانی که چند صفحه دارید که در آنها روی یک کلمه کلیدی کار می کنید، در واقع با خودتان در حال رقابت هستید. در نتیجه هر صفحه دارای CTR کمتر، قدرت کمتر و نرخ تبدیل کمتر نسبت به یک صفحه دارای یک کلمه کلیدی واحد خواهند بود. این مشکل ر اصطلاحا keyword cannibalization می گویند.

keyword cannibalization یا تکرار کلمه کلیدی چیست؟

معنای لغوی cannibalization یعنی هم نوع خواری و تکرار کلمات کلیدی در چند محتوا keyword cannibalization نامیده می شود به این دلیل که شما در حال رقابت با نتایج خودتان هستید. زمانی که این اتفاق می افتد، وسعت و عمق دانش خود را به گوگل ارائه نمی دهید و در نتیجه قدرت سایت خود را برای یک عبارت خاص (Query) تقویت نمی کنید. در عوض از گوگل می خواهید که قدرت صفحات تان را در مقابل یکدیگر قرار دهد و آن صفحه ای را که برتر است انتخاب کند.

به عنوان مثال سایت زیر در کلمه کلیدی خرید عسل دچار cannibalization شده است:

بسیاری از سایت ها دچار مشکل keyword cannibalization هستند بدون اینکه صاحبان آنها اطلاعی از آن داشته باشند. آنها حتی خوشحالند که صفحه مورد نظرشان جایگاه پنجم و ششم گوگل را روی کلمه کلیدی مورد نظر گرفته است، بدون اینکه تشخیص بدهند با داشتن یک صفحه معتبر رتبه بهتری خواهند گرفت.

عواقب مربوط به keyword cannibalization کاملا واضح هستند، از جمله: از دست رفتن ترافیک سایت، هدایت کاربران به صفحات اشتباه، نوسان رتبه بندی در نتایج جستجوها و در نهایت از دست دادن فروش.

علت بروز این مشکلات چیست؟

اعتبار و قدرت صفحه خود را تقلیل و تقسیم می کنیدبه جای داشتن یک صفحه معتبر و قدرتمند، CTR خود را در چند صفحه ضعیف تر و مرتبط به هم تقسیم می کنید. اساسا در این شرایط شما صفحات سایت خود ر رقیب یکدیگر کرده اید و در حال جنگیدن با یکدیگر برای گرفتن بازدید هستید.

قدرت لینک ها و انکر تکست ها را کم می کنیدبک لینک هایی که می توانند به یک منبع اطلاعاتی بروند، با keyword cannibalization بین دو یا چند صفحه تقسیم شده اند. به همین ترتیت انکر تکست ها و لینک های داخلی کاربران را به جای اینکه به یک صفحه معتبر و با یک موضوع واحد هدایت کنند، آنها را چند صفحه مختلف هدایت می کنند.

گوگل ممکن است صفحات مرتبط بیشتری را فاقد ارزش کندکلمات کلیدی اصلی ترین روشی است که به وسیله آن به گوگل می فهمانیم موضوع صفحه ما چیست. گوگل نیز سعی می کند بهترین صفحه مربوط به کلمه کلیدی را انتخاب کند و اگر محتوای چند صفحه خیلی شبیه به یکدیگر باشند، اشتباه رخ خواهد داد.

بودجه سایت (crawl budget) خود برای خزیدن ربات های گوگل را خراب می کنیدبودجه خزیدن یا crawl budget تعداد دفعاتی است که ربات موتورهای جستجو در یک دوره زمانی در سایت شما می خزند. وجود چند صفحه مختلف که به یک کلمه کلیدی اختصاص داده شده، باعث می شود این ربات ها در صفحاتی وارد شده و آنها را ایندکس کنند که اصلا نیاز به آنها نیست.

این مسئله شاید در سایت های کوچک مشکلی ایجاد نکند، اما در سایت بزرگ دارای تجارت الکترونیکی و چند محصوله این مسئله مشکل ساز خواهد شد.

نشان دهنده کیفیت پایین صفحاتوجود چند صفحه که دارای یک کلمه کلیدی هستند به کاربران می گوید که احتمالا محتوای شما آنقدر قوی نیست و همچنین به گوگل نیز می گوید که ممکن است محتوای شما در هر صفحه ممکن است با کلمه کلیدی شما سازگاری نداشته باشد.

نرخ تبدیل Conversion Rate در سایت شما دچار مشکل خواهد شدمطمئنا یکی از صفحات شما بهتر از بقیه عمل می کند. به جای هدایت کاربران جدید به این صفحه و قدرتمندتر کردن آن صفحه، در واقع با هدایت به صفحات دیگر قدرت را از آن صفحه می گیرید.

چطور keyword cannibalization را تشخیص دهیم؟خوشبختانه زمانی که به وجود این مشکل در سایت خود پی ببرید، حل آن بسیار ساده است.

تشخیص keyword cannibalization نیز به سادگی ایجاد ماتریکس کلمات کلیدی است. کافیست صفحه ای ایجاد کنید که تمام URL های مهم سایت و کلمات کلیدی مرتبط با آنها را لیست کنید.

به عنوان مثال اگر سایت شما مربوط به فروش کفش است، صفحه ایجاد شده احتمالا شبیه به تصویر زیر خواهد بود:

یا به روشی دیگر می توانید از ابزار keyword mapping استفاده کنید که مشابه تصویر زیر است:

چگونگی حل مشکل keyword cannibalization بستگی به علت بروز آن دارد. بیشتر اوقات رفع مشکل به سادگی ساماندهی کلمات کلیدی است، اما گاهی ممکن است لازم باشد از ریدایرکت ۳۰۱ استفاده کنید و یا لندینگ پیج جدید ایجاد کنید.

وب سایت خود را بازسازی کنید.ساده ترین راه این است که قدرتمندترین صفحه را در نظر گرفته و آن را به لندینگ پیج خود تبدیل کنید که لینک سایر متغیرهایی که زیر چتر کلمه کلیدی هدفتان قرار گرفته اند، به این صفحه داده می شود. اگر دوباره مثال فروش کفش را در نظر بگیریم، منطقی است که صفحه کفش ها را به عنوان صفحه منبع کانونی خود در نظر بگیریم و تمام صفحات دیگر را به این صفحه لینک دهیم.

لندینگ پیج جدید ایجاد کنیداز طرف دیگر ممکن است فاقد یک صفحه فرود یا لندینگ پیجی باشید که بتوانید در آن تمام محصولات خود را تلفیق کنید. در مثال ذکر شده مربوط به فروش کفش ممکن است صفحه ای با نام کفش های ورزشی و صفحه دیگری با نام کفش کوه ایجاد کنیم.

محتوای خود را تقویت و تلفیق کنیداگر محتوای صفحات شما منحصر به فرد نیستند، بهتر است آنها را با هم تلفیق کنید. به این ترتیب این شانس را دارید که دو صفحه نسبتا ضعیف را تبدیل به یک صفحه قدرتمند کنید. به علاوه این روش مشکل محتوای بی کیفیت را نیز حل می کند.

کلمات کلیدی جدید پیدا کنیددر نهایت اگر وب سایت شما دارای صفحات متنوع و دارای محتوای قوی است و تنها مشکل عدم وجود استراتژی برای کلمات کلیدی است، توصیه می کنیم کلمات کلیدی جدیدی پیدا کنید. فقط اطمینان حاصل کنید که این کلمات کلیدی به درستی محتوای صفحه را توصیف می کند.

از ریدایرکت ۳۰۱ استفاده کنیدریدایرکت ۳۰۱ این امکان را فراهم می کند که با لینک دادن از صفحات بی اعتبار به یک صفحه قدرتمند و معتبر، محتوای یکسان خود را تلفیق کنید. به یاد داشته باشید که این روش فقط برای صفحاتی با محتوای مشابه و کلمات کلیدی با کووری های یکسان مناسب است.

این ۵ راه حل ارائه شده در اکثر موارد مشکل keyword cannibalization را برطرف می کند، اما اگر یک وب سایت تجارت الکترونیک را مدیریت می کنید، بایدد به این مسئله دقت کنید که چطور CMS شما محصولات را با اندازه و رنگ متغیر تفکیک می کند. برخی برنامه های CMS صفحات مجزا برای هر محصول ایجاد می کنند.

اگر سیستم مدیریت محتوا شما اینگونه است، یا با فایل robots یا <meta name=”robots” content=”noindex”> tags مانع ایندکس شدن صفحات تکراری شوید و یا از URL های canonical برای ادغام محتواهای تکراری استفاده کنید.

نتیجه گیریامروزه keyword cannibalization نسبت به گذشته بیشتر شده است. متاسفانه قربانیان keyword cannibalization وبمسترهایی هستند که اهمیت سئو را برای تجارت خود تشخیص می دهند. اما همان زمانی که سعی دارند سایت خود را بهینه سازی کنند، زبان گوگل را به درستی متوجه نمی شوند.

خوشبختانه اگر سایت شما دچار این مشکل شده، رفع آن کار سختی نیست و آسیب ناشی از آن هم ماندگار نیست.

- توضیحات

- نوشته شده توسط سئو هکر

محتوای تکراری بدان معنی است که محتوای مشابه در چندین (URL) در وب ظاهر می شود و در نتیجه موتورهای جستجو نمی دانند دقیقا کدام URL را برای نمایش در نتایج جستجو نشان دهند. این می تواند به رتبه بندی یک صفحه سایت صدمه بزند و مشکل وقتی بدتر می شود که افراد شروع به

نوشته محتوای تکراری چیست؟ اولین بار در آپسئو. پدیدار شد.

- توضیحات

- نوشته شده توسط سئو هکر

محتوا نویسی برای سئو سایت و کلا نوشتن یک عنصر مهم در هر استراتژی سئو است. محتوای با کیفیت بالا همان چیزی است که به شما کمک می کند رتبه بندی شوید و سایت خود را از همه سایت های دیگر جدا کنید. اگر شما می خواهید محتوا نویسی برای سئو سایت انجام دهید پس

نوشته محتوا نویسی برای سئو سایت چگونه است؟ اولین بار در آپسئو. پدیدار شد.

- توضیحات

- نوشته شده توسط سئو هکر

ارتقا سئو وب سایت برای سایتی که با ایده عالی شوع کرده اید حیاتی است زیرا شما می خواهید ایده شگفت انگیزتان بازدید کننده داشته باشد.

اما از کجا باید شروع کرد و راه حل ارتقا سئو وب سایت چیست؟

نصب افزونه های کمکی سئو سایتمشروط بر اینکه سایت شما وردپرسی است می توانید از افزونه های مختلفی برای سئو سایت وردپرس خود استفاده کنید ، در سایت های وردپرسی می توانید از افزونه سئو وردپرس Yoast استفاده کنید ، خوشبختانه سیستم مدیریت محتوای وردپرس از سئو عالی برخوردار است و این افزونه نیز مکمل عالی برای آن می باشد که می تواند کمک شایانی به در ارتقا سئو وب سایت به شما بکند.

بک لینک دریافت کنیدگوگل برای اینکه بتواند شما را پیدا کند و همچنین از اعتبار شما مطمئن باشد باید حداقل یک بک لینک داشته باشید ، بهتر است این بک لینک از یک سایت معتبر و مرتبط باشد تا مشکلی برای سایت شما پیش نیاید.

هدف از رتبه بندی و ارتقا سئو وب سایت چیست؟در واقع برای چه چیزی می خواهید رتبه بندی کنید؟ مشتری شما چه کسانی هستند؟ برای چه کسی این سایت را ساخته اید؟ مشتری شما هنگام جستجو در گوگل چه عبارتی را جستجو می کند؟

این ها مهمترین سئوالاتی است که باید از خود بپرسید و برای تک تک آنها راه حل عالی تهیه کنید.

بهترین کار برای اینکه بدانید مناسبترین عبارتی که مردم درباره شما جستجو می کنند چیست ، تحقیقات کلیدواژه است ، ابزار های مختلفی برای اینکار وجود دارد ، البته فرامش نکنید ابزار های قابل استفاده برای تحقیق کلمات کلیدی زمانی مفید خواهند بود که شما درباره مخاطب خود اطلاعات کافی داشته باشید.

اهداف واقع بینانه برای سئو سایت تعیین کنیدبرای یک سایت جدید ، در ابتدا به دست آوردن رتبه بالا کار سختی است. سایت های قدیمی تر از قبل سابقه ای دارند ، این بدان معنی است که خزندگان گوگل بیشتر در سایت های قدیمی تر رفت آمد می کنند؛ برای رتبه بندی سایت جدید ، باید کمی صبور باشید.

اگر سایت تازه ای برای ارتقا سئو دارید بهتر است از عبارات طولانی استفاده کنید، عبارات کوتاه به دلیل رقابت سنگین آن ها تقریبا برای سایت های جدید غیر ممکن خواهد بود.

لینک سازی داخلیهمانطور که در پاراگراف بالا درباره بک لینک صحبت کردیم و از شما خواستیم برای اینکه گوگل شما را سریع تر بیابد باید حداقل یک لینک از سایت مرتط دیگر داشته باشید ، برای لینک سازی داخلی نیز باید برنامه داشته باشید چون گوگل برای پیدا کردن صفحات سایت نیاز به درگاه ورودی دارد ، این همان لینک داخلی است.

خزنده های گوگل با لینک های داخلی سایت شما اقدام به خواندن و پیدا کردن صفحات سایت می کنند.

محتوا تولید کنیدبرای کسب رتبه ، باید محتوا داشته باشید. یک قدم بسیار مهم برای شروع سئو، نوشتن مطالب شگفت انگیز برای همه کلمات کلیدی است که مخاطبین آن را جستجو می کنند.

حین نوشتن ، حتماً از کلماتی که می خواهید شما را پیدا کنند استفاده کنید. از آنها در عنوان ها و در معرفی و نتیجه گیری متن استفاده کنید. پس از نوشتن متن ، باید عنوان سئو و توضیحات متا را بهینه کنید.

- توضیحات

- نوشته شده توسط سئو هکر

این روزها افزایش ترافیک وبسایت دغدغه اصلی تمام صاحبان کسب و کارها و برندهایی است که وبسایتی را برای فروش محصولات و یا تبلیغات خود راه اندازی کرده اند. در واقع افزایش بازدید سایت یک مهارت ضروری برای صاحبان سایت ها و کسب و کار های اینترنتی است اما مسئله اینجاست که برای بدست آوردن ترافیک واقعی باید چه کارهایی صورت گیرد؟ اگر به دنبال افزایش بازدید واقعی سایت خود هستید با سایت سئو همراه شوید تا بهترین و کاربردی ترین روش های افزایش ترافیک را با شما در میان بگذاریم.

راهکارهای افزایش ترافیک واقعی برای وبسایت معرفی سایت به موتورهای جستجواین راهکار مهم ترین و موثرترین گام در جهت افزایش ترافیک است. صفحات سایت خود را به گونه ای بهینه سازی کنید که وقتی فرد کلمه کلیدی خود را در نوار جستجو تایپ می کند، سایت شما در صفحه اول نتایج جستجو ظاهر شود. گوگل، بینگ و یاهو از جمله رایج ترین موتورهای جستجو هستند اما یک سایت برای بهتر دیده شدن باید در تمام مراجع آنلاین و موتورهای جستجو ثبت شود زیرا در این صورت بازخورد بهتری خواهد داشت و ترافیک بالاتری به آن روانه خواهد شد.

انتشار مقالات پر مخاطب و دارای کلمات کلیدی مهمشما می توانید مقاله های جدید کوتاه یا بلند تالیف یا حتی ترجمه کنید و در آن ها از کلید واژه های اصلی استفاده نمائید. انتشار چنین مقالاتی نه تنها ترافیک سایت را بالا برده بلکه شما را به عنوان یک متخصص در حوزه کاری خود به مخاطبان معرفی می نماید. هنگامی که مقالات شما در سایت های دیگر منتشر شوند ترافیک رایگان دریافت خواهید کرد.

بهینه سازی عنوان مقالاتتیترها نقش بسیار مهمی در جلب توجه افراد دارند و اگر به صورت کوتاه و جذاب نوشته شوند بی شک سریع تر بر روی آن ها کلیک خواهد شد. مخاطبان شبکه های اجتماعی علاقه بیشتری به عنوان های گیرا و کوتاه نشان می دهند و آن ها را بیشتر از عناوین طولانی به اشتراک می گذارند. بنابراین مقالات خوب سایت را بهینه سازی نموده و عنوان آن ها را با توجه به علایق مخاطب به روزرسانی کنید.

ترویج محتوا در رسانه های اجتماعیانتشار محتوا در کانال های اجتماعی منجر به افزایش بازدید و در نتیجه ترافیک خواهد شد. با این کار یافتن سایت و ورود به آن نیز برای کاربر راحت تر شده و افراد بیشتری برای مشاهده آن راغب می شوند. برای بهتر دیده شدن می توانید در فیسبوک، لینکدین و سایر شبکه های اجتماعی پست گذاشته و به منظور افزایش مخاطب از هشتگ های مرتبط استفاده نمائید.

انتشار مقالات سایت در وبلاگ هابه منظور بازدید بیشتر سایت می توانید در وبلاگ های مرتبط با کسب و کار خود محتوا انتشار دهید. برای مثال از یک وبلاگ نویس درخواست کنید تا به شما اجازه دهد محتوایی مرتبط، منحصر بفرد، با کیفیت و جامع در وبلاگ وی قرار داده و در مقابل بک لینک دریافت نمائید. با انجام اینکار شما به راحتی ترافیک سایت خود را چند برابر افزایش خواهید داد.

کاهش نرخ پرشبانس ریت یا نرخ پرش بالا نه تنها به سئو سایت آسیب می زند بلکه خطرات جدی به همراه دارد. برای اینکه نرخ پرش را کاهش دهید، ابتدا باید محتوای منحصر بفرد تولید کنید و با بهبود طراحی سایت سرعت آن را افزایش دهید. همچنین با پیروی از یک استراتژی مناسب و موثر برای لینک سازی داخلی و بهبود نحوه ورود کاربران به سایت می توانید به میزان قابل توجه بانس ریت را پایین آورید.

تبادل لینک با سایر سایت هایکی از روش های دستیابی به ترافیک بالا، تبادل لینک با سایت های مرتبط با حوزه کسب و کار شماست. اینکار نه تنها برای شما، بلکه برای سایت مقابل نیز سودآور خواهد بود. بدین منظور بهتر است با سایت هایی که دارای رتبه الکسای مشابه شما هستند تبادل لینک کنید زیرا برخی از سایت های برتر که رتبه بالایی دارند حاضر به تبادل لینک نیستند.

قابلیت استفاده از سایت در موبایل و تبلتهمواره در طراحی وبسایت به واکنش گرا بودن آن تاکید شده است. در واقع می توان گفت یک سایت باید از قابلیت نمایش بر روی تبلت و موبایل برخودار باشد. طراحی صفحات سایت برای استفاده در گوشی های همراه یک مزیت بزرگ برای سایت است و تاثیر بسزایی بر سئو آن می گذارد.

در نظر گرفتن تخفیفات ویژه برای محصولات سایت از طریق کانال های اجتماعیتخفیفات و پیشنهادات ویژه برای فروش موثرترین عامل جذب مشتری برای سایت است و اگر این ترفند در رسانه های مختلف در معرض دید قرار گیرد مسلماً افراد بیشتری وارد سایت شما خواهند شد.

ترویج تبلیغاتشما می توانید در سایت های مرتبط با حوزه کاری خود تبلیغ کنید و در مقابل فضایی را برای تبلیغ آن ها در سایت خود اختصاص دهید. مسلماً بنرهای تبلیغاتی با رنگ های زیبا و جذاب توجه بازدیدکنندگان را جلب نموده و آن ها را برای ورود به سایت شما ترغیب خواهند کرد.

سایت های افزایش ترافیک خوب یا بد؟ما قصد تخریب سایت یا شخصی را نداریم اما چون این مسئله در حال حاضر در فضای وب در حال گسترش است، می خواهیم به توضیحاتی در این خصوص بپردازیم. برای فروختن بازدید فیک و در نتیجه بهبود رتبه الکسا، سایت هایی راه اندازی شده اند. این سیستم های افزایش ترافیک یا تبادل ترافیک یا در اصل همان Fake Hits تنها مزیتی که دارند این است که رتبه الکسای شما را حتی اگر خیلی هم بد باشد کاهش می دهند، البته به صورت موقت و دروغین و سود دیگری برای شما ندارند. در سیستم های جدید چون در یک زمان چندین پنجره باز می شود، شخص بازدید کننده اصلا سایت شما را نمی بیند اما در سیستم های قدیمی تنها یک سایت نمایش داده می شد و بازدید کننده باید 60 ثانیه در سایت می ماند، از این رو با وجود سیستم های امروزی فرد دیگر به سایت شما سر نخواهد زد.

البته با توجه به پیشرفتی که هر روز در دنیای تکنولوژی رخ می دهد، انتقاد پذیر شدن دوستان و مطالعه مقالاتی که ایراد سیستم های مذکور را گوشزد می کنند، این سیستم ها در حال حاضر به روز شده و دیگر 15 سایت را هم زمان نمایش نمی دهند اما باز هم در بعضی از آن ها اگر تب مرورگر جلوی کاربر باز نباشد، وی حتی یک لحظه هم برای بازدید زمان نمی گذارد. در واقع برخی مشکلات این سیستم ها رفع شده اما مشکل اصلی آن ها همچنان پا برجاست. ایراد اساسی و مهم این سایت ها این است که شما را به رتبه جعلی امیدوار می کند و شما دیگر تمایلی به به روزرسانی مطالب سایت ندارید. باید این موضوع را مد نظر داشته باشید که رتبه مناسب در گوگل باعث افزایش رنک الکسا خواهد شد. ولی رتبه بالای الکسا که بوسیله سایت های افزایش ترافیک حاصل می شود تاثیری بر رتبه گوگل شما نخواهد داشت. بهترین و ارزشمندترین کاری که می توانید برای سایت خود انجام دهید، استفاده از روش های مطرح شده در این نوشته است.

در پایاندر این نوشته از سایت سئو به معرفی تعدادی از مهم ترین راهکارهای افزایش ترافیک وبسایت پرداخته شد. نکته اینجاست که تعداد بازدید سایت به راحتی ایجاد نمی شود و باید برای آن برنامه ریزی شود و راهکارها به مرور زمان و طبق برنامه پیاده سازی شود. پیشنهاد ما این است که ابتدا از بهینه سازی سایت خود شروع کنید و به دنبال روش های زودبازده و ترافیک های فیک نباشید.

افزایش ترافیک وبسایت باعث می شود که یک سایت بازدید کنندگان بیشتری داشته باشد و از این رو برای صاحبان کسب و کارهای اینترنتی یک مسئله مهم و ضروری است.

در ابتدا باید سایت را به موتورهای جستجو معرفی کنیم و پس از برطرف کردن مشکلات تکنیکال وبسایت روی محتوا و ترویج آن سرمایه گذاری کنیم. در کنار این موارد تبلیغات از اهمیت ویژه ای برخوردار است.

زیرا رتبه بالای الکسا توسط سایت های افزایش ترافیک تاثیری بر رتبه بندی گوگل ندارد.

انتشار محتوای مرتبط با حوزه کاری برند شما میتواند شما را به عنوان یک متخصص به کاربران معرفی کند. علاوه بر آن اشتراک گذاری محتوا در رسانه های مختلف با کسب ترافیک رایگان همراه است.

4.7/5 (3 نظر)

- توضیحات

- نوشته شده توسط سئو هکر

در نوشته های قبلی سایت سئو درباره انتخاب عنوان مناسب برای صفحات سایت صحبت شد و در این نوشته به بررسی کامل متاتگ توضیحات و اهمیت بهینه سازی آن می پردازیم. برای دریافت پاسخ سوالات خود همراه ما باشید.

توضیحات صفحات سایت بسیار حائز اهمیت است و همان طور که عنوان مناسب صفحه در جستجوهای گوگل تاثیر دارد، توضیحات صفحه نیز تاثیر بسزایی در راهنمایی کاربران دارد. متا تگ توضیحات خلاصه ای از محتوای سایت را ارائه می دهد. این تگ در جستجوهای گوگل به نمایش در می آید و جستجوگر به راحتی متوجه می شود که سایت شما با موضوع مورد نظر او هماهنگی دارد یا ندارد. در گذشته متا تگ دیسکریپشن نقش مهمی در رتبه بندی سایت ها در نتایج جستجو ایفا می کردند اما اخیراً گوگل اعلام کرده است که این متا تگ تاثیر مستقیمی در افزایش رتبه گوگل ندارد. اگر چه این متا تگ تاثیر مستقیم در رتبه بندی ندارد اما با توجه به مطالبی که در ادامه به آن ها اشاره می کنیم، متوجه می شوید که همچنان از اهمیت ویژه ای برخوردار است و در بهینه سازی سایت باید مورد توجه قرار گیرد.

متا تگ توضیحات چیست؟متا تگ دیسکریپشن (Description) یک تگ HTML است که در آن توضیحات مختصری درباره موضوع صفحه قرار دارد. این متا تگ زیر عنوان صفحه قرار می گیرد و در صفحه نتایج جستجو به نمایش در می آیند.

اهمیت متا تگ توضیحات برای سئویکی از دلایل مهم استفاده از متا تگ توضیحات، راهنمایی کاربران در انتخاب بهترین گزینه در نتایج جستجو است. هنگامی که کاربر جستجویی را انجام می دهد، تگ توضیحات و عنوان صفحه قابل مشاهده است. این دو عامل به کاربر کمک می کند تا بتواند بهترین گزینه را از میان گزینه های پیش رو انتخاب کند. به عنوان مثال اگر فردی کلمه ” شیر” را جستجو کند و به دنبال شیر جنگل باشد با ارائه توضیحات مناسب وارد سایت هایی که در مورد لبنیات و شیر خوراکی است نمی شود و سریع تر به خواسته خود می رسد.

علاوه بر این یک متا دیسکریپشن بهینه، نرخ کلیک سایت در نتایج جستجو را افزایش می دهد. افزایش نرخ کلیک توسط متا تگ توضیحات، افزایش ترافیک سایت را به همراه دارد. افزایش نرخ کلیک و ترافیک سایت در کنار یکدیگر باعث ارتقا رتبه وبسایت و قرار گیری در صفحه اول گوگل می شود. در صورتی که توضیحات شما با خواسته اصلی کاربران منطبق باشد قطعاً سایت شما برای آن ها جذاب است و می تواند افزایش نرخ تبدیل را با خود به همراه داشته باشد.

علاوه بر موارد ذکر شده یکی از عوامل مهم و تاثیر گذار بر رتبه بندی وبسایت شما نرخ پرش یا بانس ریت صفحات است. تعداد زیادی از بازدید کنندگان بدون این که از صفحات دیگر سایت بازدید کنند و یا فعالیت مفیدی در سایت انجام دهند از آن خارج می شوند و مجدداً به صفحه نتایج جستجو بر می گردند این مورد به گوگل نشان می دهد که متای توضیحات شما با محتوای سایت شما متفاوت است و قطعا این قضیه بر رتبه بندی وبسایت شما تاثیر منفی دارد.

نکات مهم برای نوشتن متاتگ توضیحات انتخاب عبارات جذاب و مناسب برای توضیحات صفحات سایتسعی کنید در انتخاب کلمات خود کاملاً خلاقانه عمل کنید و عباراتی را انتخاب کنید که برای کاربران جذاب باشد و آن ها را برای انتخاب سایت شما در میان رقبا ترغیب کند.

منحصر به فرد بودن توضیحات متا برای صفحات مختلف سایتبهتر است متای دیسکریپشن صفحه اصلی سایت با دیگر صفحات متفاوت باشد. در واقع هر صفحه با توجه به محتوای خاص خود می تواند توضیحات ویژه خود را داشته باشد. متفاوت بودن توضیحات صفحات مختلف سایت تجربه کاربری بهتری را برای بازدیدکنندگان سایت به همراه دارد.

استفاده از کلمات کلیدی در توضیحات متاگوگل در صفحه نتایج جستجو کلمات کلیدی موجود در متا تگ توضیحات را پر رنگ تر نمایش می دهد و از این طریق کاربران را برای انتخاب گزینه مناسب تر راهنمایی می کند. هر چند این مسئله پارامتری برای رتبه بندی سایت نیست اما کاربر را به هدف خود نزدیک تر می کند. استفاده از کلمات کلیدی در توضیحات متا محدودیت ندارد اما توصیه می شود که فقط از یک یا دو کلمه کلیدی در توضیحات استفاده شود.

از علائم و نمادهای ریاضی استفاده نکنیدموتور های جستجو علائم ریاضی را به عنوان کد HTML به حساب می آورند. اگر این نمادها در توضیحات استفاده شوند ممکن است گوگل آن ها را به عنوان کد به حساب آورد و توضیحات را نادیده بگیرد.

تعداد کاراکتر مجاز برای متا دیسکریپشنطولانی بودن توضیحات توسط گوگل جریمه نمی شود اما با توجه به این مورد که فضای محدودی برای توضیحات در نتایج جستجو در نظر گرفته شده است فقط بخشی از متن نمایش داده می شود و بقیه قسمت ها به صورت … نمایش داده می شود لذا بهتر است طول متاتگ توضیحات بین 150 تا 170 کاراکتر باشد.

به روزرسانی توضیحات صفحات قدیمیبا به روزرسانی تگ توضیحات صفحات قدیمی و اشتراک گذاری مجدد لینک این صفحات می توانید افراد بیشتری را برای بازدید از این صفحات ترغیب کنید.

با توجه به موارد و نکات مطرح شده در این نوشته اگر چه گوگل مدت ها پیش اعلام کرده است که متاتگ توضیحات در رتبه بندی سایت تاثیری ندارد اما باید به این مسئله توجه داشته باشیم که متنی که در توضیحات قرار می دهیم در صفحه نتایج جستجو نمایش داده می شود و شدیداً مورد توجه کاربران است. هر چقدر این متن برای کاربران جذاب تر باشد احتمال انتخاب سایت و کلیک کردن بر روی آن از طرف کاربر افزایش می یابد و از این طریق نرخ CTR افزایش می یابد و جایگاه سایت شما به مرور در نتایج جستجو بهبود می یابد.

از همین امروز برای نوشتن و بهینه کردن متا دیسکریپشن سایت خود اقدام کنید و مواردی مانند طول توضیحات، جذابیت عبارت انتخابی، استفاده از کلمات کلیدی و توجه به هویت و برند سایت را برای نوشتن توضیح مناسب در نظر داشته باشید. با این کار یک قدم به بهینه سازی سایت خود نزدیک تر می شوید.

سوالات مرتبط با متاتگ توضیحات

متا تگ دیسکریپشن (Description) یک تگ HTML است که در آن توضیحات مختصری درباره موضوع صفحه قرار دارد.

بهتر است طول متاتگ توضیحات بین 150 تا 170 کاراکتر باشد.

گوگل در صفحه نتایج جستجو کلمات کلیدی موجود در متا تگ توضیحات را پر رنگ تر نمایش می دهد و از این طریق کاربران را برای انتخاب گزینه مناسب تر راهنمایی می کند.

4/5 (1 نظر)

- توضیحات

- نوشته شده توسط سئو هکر

سیستم مدیریت محتوا چیست؟ انواع سیستم مدیریت محتوا کدام است؟ سیستم مدیریت محتوا چگونه می تواند به شما کمک کند؟

در این نوشته از سایت سئو به معرفی انواع سیستم های مدیریت محتوا می پردازیم. برای دریافت پاسخ سوال های بالا تا انتها با ما همراه باشید.

CMS چیست؟یکی از مواردی که در مرحله اول برای راه اندازی یک وبسایت مطرح می شود، طراحی سایت است. ممکن است که شما یک برنامه نویس حرفه ای باشید و از دستورات html یا php و … استفاده کنید و یا با توجه به سایت خود یکی از سیستم های مدیریت محتوای سایت را مورد استفاده قرار دهید. سیستم مدیریت محتوا یا CMS، یک سیستم نرم افزاری است که توسط آن می توان به آسانی محتوا را مدیریت کرد. در واقع برنامه های مدیریت محتوا و یا Content Management System به مدیر یک وبسایت توانایی مدیریت و بروز رسانی اطلاعات را می دهند. با استفاده از انواع مختلف سیستم های مدیریت محتوا می توانید بدون مسلط بودن به دانش برنامه نویسی بخش های مختلف سایت خود مثل متن ها، تصاویر و ویدیو ها را بدون نیاز به طراحی مجدد تغییر دهید. اغلب این سیستم ها توسط افزونه ها برای شما امکانات زیادی را ایجاد می کنند. ظهور سیستم های مدیریت محتوا توانسته است، مدیران کسب و کارهای زیادی را به داشتن یک وبسایت در حوزه کاری خود تشویق کند. امروزه تعداد زیادی سیستم های مدیریت محتوا در دسترس هستند و هر یک از آن ها قابلیت های متفاوتی را برای کاربران فراهم می کنند که شخصی که قصد استفاده از آن ها را دارد می تواند با توجه به وبسایت خود مناسب ترین آن ها را انتخاب کند.

در ادامه این نوشته به معرفی تعدادی از پرکاربرد ترین سیستم های مدیریت محتوا می پردازیم. برای انتخاب مناسب CMS کاربردی خود تا پایان این نوشته همراه ما باشید.

یک CMS مناسب چه ویژگی هایی دارد؟شاید بسیاری از افراد بر این باورند که CMS ها فقط برای وبلاگ نویسی مناسب هستند اما باید بگوییم که سیستم مدیریت محتوا در پیاده سازی فروشگاه های اینترنتی نقش موثری داشته اند. یک CMS کاربردی باید بستری را فراهم کند تا مدیر سایت بتواند به آسانی محتوای جدید خود را منتشر کند و بتواند محتوا را دسته بندی و سازمان دهی کند. علاوه بر این سیستم مدیریت محتوای شما باید ابزارهای لازم جهت ویرایش صفحات را داشته باشد. قابلیت سفارشی سازی و اضافه کردن ویژگی های دلخواه به وبسایت نیز یکی دیگر از ویژگی های یک CMS قدرتمند است. توجه داشته باشید که در این میان استفاده از قالب های استاندارد و سئو مدار بسیار حائز اهمیت است.

معرفی انواع سیستم های مدیریت محتوا 1. WordPress

این روز ها یکی از موفق ترین نرم افزارهای راه اندازی و طراحی وبسایت سیستم مدیریت محتوای وردپرس است. این سیستم به شما اجازه می دهد، یک سایت کاملاً داینامیک راه اندازی کنید. این سیستم در عین سادگی محتوای سایت شما را در کمترین زمان ممکن منتشر و یا به روزرسانی می کند. کاربر پسند بودن، پنل مدیریت، منطبق بودن با قوانین سئو و سهولت انجام کار، این سیستم را به یکی از محبوب ترین سیستم های مدیریت محتوا تبدیل کرده است. شما می توانید در محیط وردپرس محتوای متنی خود را قرار دهید و مانند محیط نرم افزار Word آن را ویرایش کنید و تصاویر مورد نظر خود را در اندازه های مختلف آپلود کنید. همچنین با نصب افزونه های رایگان می توانید امکانات زیادی را به وبسایت خود اضافه کنید. مهم ترین نکته این است که بیشتر افزونه ها به صورت رایگان در اختیار کاربران قرار می گیرد. با استفاده از افزونه های حرفه ای وردپرس می توانید هم زمان مطالب خود را در شبکه های اجتماعی نیز منتشر کنید. با بهره گیری از افزونه های رایگان وردپرس می توانید بهینه سازی وردپرس را به آسانی انجام دهید. وردپرس امکانات راه اندازی وبسایت های مختلف وبلاگی، فروشگاهی، شرکتی و خبری را برای شما فراهم کرده است.

Joomla .2

جوملا یک سیستم مدیریت محتوای رایگان است و به زبان PHP منتشر می شود. این CMS بسیار انعطاف پذیر است و برای مدیریت کردن پست های سفارشی مناسب است. یکی از مهم ترین قابلیت های جوملا امکان ایجاد سایت های چند زبانه است. در واقع شما دیگر نیازی به استفاده از افزونه ها برای داشتن زبان بیشتر در سایت را ندارید. این پلتفرم این امکان را برای شما فراهم می کند تا بتوانید برای انواع محتوای خود از چندین قالب و یا تم به صورت هم زمان استفاده کنید. اگر چه جوملا در نگاه اول جذاب به نظر می رسد اما استفاده از این CMS بیشتر به کسانی پیشنهاد می شود که دانش و تجربه کد نویسی دارند. اگر می خواهید از سیستم مدیریت محتوای جوملا استفاده کنید باید به فکر سئو جوملا باشید تا بتوانید در صفحه اول گوگل قرار بگیرید.

Drupal .3

در کنار وردپرس و جوملا، دروپال یکی دیگر از بزرگترین و محبوب ترین سیستم مدیریت محتوا در جهان است. این CMS به دلیل متن باز بودن آن مورد توجه بسیاری از کاربران است. دروپال در بسیاری از موارد مانند سیستم مدیریت پست های سفارشی همانند جوملا عمل می کند. توسط آن به آسانی می توانید سایت های چند زبانه ایجاد کنید. سیستم طبقه بندی دقیق و امنیت بسیار بالا از دیگر قابلیت های دروپال است. در این سیستم پشتیبان های آنلاین و انجمن های فعال جهت رفع مشکلات احتمالی شما حضور دارند. شاید بتوان در مورد نقاط ضعف این CMS به کم بودن تعداد قالب های رایگان و پیچیدگی فرآیند تولید قالب اشاره کرد. در سایت سئو می توانید فیلم آموزش بهینه سازی سایت های دروپال را مشاهده کنید.

Magento .4

مجنتو یکی دیگر از سیستم های مدیریت محتوا و از نوع پلتفرم متن باز می باشد. می توان گفت که مجنتو یکی از بی نظیر ترین فروشگاه سازها در دنیا است. نسخه همگانی مجنتو به توسعه دهندگان برای راه اندازی فروشگاه آنلاین منحصر به فرد کمک می کند. این سیستم فروشگاه ساز در سال 2008 منتشر شده است و هم اکنون بیش از 200 هزار فروشگاه فعال دارد که از جمله آن می توان به فروشگاه های بزرگی مانند نوکیا، سامسونگ و آدیداس اشاره کرد. با استفاده از این فروشگاه ساز می توانید هر آنچه را که برای سایت خود نیاز دارید، در دسترس داشته باشید. مجنتو همه موارد را برای ایجاد، گسترش تبلیغات و مدیریت فروشگاه اینترنتی در اختیار شما قرار داده است. این CMS دارای قالب های رایگان است. از معایب آن می توان به رایگان نبودن نسخه حرفه ای آن اشاره کرد.

Blogger .5

سیستم مدیریت محتوای بلاگر برای ساخت وبلاگ مورد استفاده قرار می گیرد و هاستینگ و مالک آن شرکت گوگل است. کار با این CMS بسیار آسان است و به دلیل این که این سیستم توسط گوگل توسعه یافته کاملاً با موتورهای جستجو همخوانی دارد و از نظر سئو از کیفیت بالایی برخوردار است. راه اندازی آن بسیار آسان است و دامنه و هاست آن نیز رایگان است. مهم ترین نکته ای که باید به آن توجه داشته باشید این است که بلاگر فقط برای ساخت وبلاگ مناسب است و اگر شما سایتی با امکاناتی غیر از وبلاگ در نظر داشته باشید، برای شما کارساز نیست. محدود بودن این سیستم مدیریت محتوا باعث شده است تا افراد کمتری از آن استفاده کنند.

سیستم مدیریت محتوا و تاثیر آن بر سئواستفاده از سیستم های مدیریت محتوا می توانند در کمترین زمان و با صرف کمترین هزینه ممکن شما را در رسیدن به اهدافتان یاری کنند. توسط این سیستم ها به راحتی می توانید سایت خود را مدیریت کنید و در آن تغییرات لازم را ایجاد کنید. در بیشتر CMS ها بخشی از فاکتور های سئو که مربوط به تولید و انتشار محتوا است رعایت می شود. علاوه بر این پلاگین ها و افزونه هایی وجود دارند که با نصب آن ها می توان طبق الگوی سئو محتوا تولید کرد. البته ممکن است برخی از CMS های موجود با مشکلاتی نظیر پایین بودن سرعت سایت، پشتیبانی ضعیف و امنیت پایین مواجه باشند پس بهتر است در انتخاب سیستم مدیریت محتوای سایت به سئو نیز توجه داشته باشیم.

در این نوشته چند مورد از مهم ترین سیستم های مدیریت محتوا را بررسی کردیم. آنچه که می تواند به شما در انتخاب یک سیستم مدیریت محتوای مناسب و کاربردی کمک کند و شما را به اهدافتان نزدیک تر کند، شناخت دقیق CMS ها و ویژگی های آن ها است. سعی کنید با توجه به وبسایت خود مناسب ترین سیستم مدیریت محتوا را انتخاب کنید.

یک سیستم نرم افزاری است که توسط آن می توان به آسانی محتوا را مدیریت کرد. در واقع برنامه های مدیریت محتوا و یا Content Management System به مدیر یک وبسایت توانایی مدیریت و بروز رسانی اطلاعات را می دهند.

یک CMS کاربردی باید بستری فراهم کند که مدیر سایت بتواند به آسانی محتوای جدید منتشر کند و آن ها را دسته بندی و سازمان دهی کند.

کاربر پسند بودن، پنل مدیریت، منطبق بودن با قوانین سئو و سهولت انجام کار، این سیستم را به یکی از محبوب ترین سیستم های مدیریت محتوا تبدیل کرده است.

وردپرس، جوملا، دروپال، مجنتو، بلاگر و .... از انواع مختلف سیستم مدیریت محتوا هستند.

5/5 (3 نظر)

- توضیحات

- نوشته شده توسط سئو هکر

داشتن یک استراتژی بلند مدت خوب برای سئو سایت کار بسیار عالی می باشد اما داشتن یک برنامه ریزی روزانه می تواند موفقیت شما را برای رسیدن به هدفتان تضمین کند.

در اینجا 6 کاری که شما باید روزنه برای سئو سایت خود انجام دهید آورده شده است.

1. مطمئن شوید محتوای تازه را در اختیار کاربران قرار می دهیددر هنگام رتبه بندی ، محتوا حرف اول را می زند پس با نوشتن محتوای جدید و یا بروز کردن محتوای قبلی اینکار را حتما انجام دهید ، حتما لازم نیست روزی یک مطلب بنویسید ، اما اگر مثلا چهرشنبه یک مطلب منتشر می کنید ، به اینکار پایبند باشید چون کاربر شما منتظر است.

بهتر است روزانه لیستی از محتوایی که می توانید برای بروز کردن آن ها اقدام کنید داشته باشید.

یادتان باشد کامنت های محتوا را پاسخ دهید، اگر فراموش کنید یا دیر جواب دهید ، کاربران دلسرد می شوند و شما را فراموش می کنند.

2. روی لینک های داخلی کار کنیدلینک های داخلی مانند فرش قرمز برای گوگل هستند ، یکی از کار های مهم شما بررسی محتوای قدیمی است ، یادتان باشد وقتی محتوای جدیدی تولید می کنید حتما یکی از نکاتی بوده که قبلا در پستی قدیمی از آن یاد شده و می تواند لینک داخلی مطلب قدیمی به مطلب جدید باشد.

3. بروز رسانی و رسیدگی به مشکلات سایتمعمولا بهترین کار در هنگام نظافت خانه تمیز کردن هر روز آن است تا قبل از روی هم شدن آشغال ها و ظروف کثیف کار را آسان تر کنید ، دقیقا همین مسئله درباره سایت شما هم اتفاق می افتد ، وقتی یک مسئله کوچک در سایت وجود دارد و آن را برطرف کنید مسائل بیشتر روی هم انباشته نمی شوند.

سایت خود را در صورت وجود نسخه جدید بروز نگه دارید ، اگر محتوایی نیاز به بهبود نوشتاری دارد آن را انجام دهید.

محتوای cannibalized را پیدا کنید تا از ایجاد رقابت بین صفحات جلوگیری کنید.

4. روی سئو فنی سایت خود کار کنیدخیلی از موارد حتما لازم نیست یک متخصص سئو باشید تا آن را برطرف کنید ، به طور مثال داشتن تصاویر با کیفیت در سایت شما ضروری است ، اما اگر نمی خواهید سایت کندی داشه باشید حتما تصاویر را در اندازه مناسب بهینه کنید؛ برای اینکار اگر فتوشاپ بلد نیستید و یا وقتش را ندارید ابزار squoosh گوگل بهترین ابزار برای این کار است.

5. به ابزار گوگل آنالیتیکز سر بزنیداگر تا به امروز از ابزار گوگل آنالیتیکز استفاده نمی کردید ، پیشنهاد می کنم حتما این ابزار سنجش ترافیک را مورد بررسی و استفاده قرار دهید ، این ابزار فوق العاده منبعی از اطلاعات مهم سایت شماست که در طول روز گرداوری کرده است ، با این ابزار می توانید بر روی استراتژی سئو خود تسلط بیشتری داشته باشید.

این ابزار اطلاعاتی مانند آنالیز رفتار کاربران ، ترافیک وارد شده و کلی مسائل مهم که روزانه در سایت شما اتفاق می افتد را ضبط می کند.

6. حضور خود را در رسانه های اجتماعی پر رنگ کنیدشبکه های اجتماعی بهترین مکان برای اطلاع رسانی و یادآوری به دیگران است که بدانند سایت شما هنوز وجود دارد و فعال است ، بهتر است هر پست ، عکس و مطلبی که فکر می کنید جذاب است را با مخاطبین خود به اشتراک بگذارید.

این شش مورد پیشنهاد ما برای بهبود سئو سایت را جدی بگیرید ، اما قطعا با کمی تمرکز موارد بیشتری نیز وجود دارد که شما می توانید روزانه به آن رسیدگی کنید تا سایت فعال و رو به رشدی داشته باشید.

- توضیحات

- نوشته شده توسط سئو هکر

درباره فایل Robots.txt بیشتر بدانید

درباره فایل Robots.txt بیشتر بدانید

یکی از ساده ترین فایل های یک وب سایت فایل Robots.txt است، اما میتواند به سادگی باعث ایجاد مشکل و خرابی می شود. اگر تنها یک کاراکتر خارج از مکان درست خود باشد، میتواند برای سئو مشکل ایجاد کند و از دسترسی موتورهای جستجو به مطالب مهم سایت جلوگیری کند.

به همین دلیل است که تصورات اشتباه درباره Robots.txt بسیار رایج است. حتی در میان متخصصان با تجربه سئو.

در این مقاله یاد خواهید گرفت:

فایل Robots.txt چیست txt به چه شکل است User-agents و دستورالعمل های فایل ربات آیا به فایل ربات نیاز داریم چگونه فایل txt وب سایت خود را پیدا کنید نحوه ی ایجاد فایل ربات TXT بهترین روش های ساخت ربات TXT مثال های از txt چگونگی بررسی و رسیدگی مشکلات بوجود آمده فایل ربات فایل Robots.txt چیست؟Robots.txt به موتورهای جستجو میگوید که به چه بخش هایی از سایت میتوانند وارد شوند و چه بخش هایی را نمیتوانند وارد شوند.

در درجه اول، تمام مطالبی که میخواهید از دسترسی موتورهای جستجو مثل گوگل خارج کنید را لیست میکند. همچنین میتوانید به برخی از موتورهای جستجو (نه گوگل) بگویید که چگونه میتوانند محتوای مجاز را کراول کنند.

جالب است بدانید که بیشتر موتورهای جستجو مطیع هستند. آنها عادت به شکستن راه ورود را ندارند در واقع میتوان گفت برخی تمایلی به برداشتن این قفل های مجازی ندارند که گوگل یکی از آن موتورهای جستجو نیست، آن از تمامی دستورالعمل های مربوط به فایل Robots.txt پیروی میکنند.

فقط این را بدانید که بعضی از موتورهای جستجو کاملا آن را نادیده می گیرند.

فایل Robots.txt چگونه ایجاد میشود؟در اینجا فرمت اصلی یک فایل Robots.txt توضیح خواهم داد :

اگر تا بحال فایلی مانند این ندیده اید، ممکن است کمی ترسناک به نظر برسد. اگرچه دستورات نوشتاری (syntax) آن کاملا ساده است. به طور خلاصه شما قوانین و قواعد را به ربات ها با تعیین مرورگر آنها و دستورالعمل های مربوط به آن اختصاص می دهید.

بیاید با جزئیات بیشتری به بررسی این دو مؤلفه بپردازیم.

User-agents

هر موتور جستجو خود را با یک User-agants متفاوت مشخص میکند. شما میتوانید دستورالعمل های سفارشی برای هر یک از این موارد را در فایل Robots.txt خود تنظیم کنید. تعداد زیادی User-agents وجود دارد، اما در اینجا چند مورد مفید برای سئو را معرفی میکنیم:

Google: Googlebot Google Images: Googlebot-Images Bing: Bingbot Yahoo: Slurp Baidu: Baiduspider DuckDuckGo: DuckDuckBotنکته : حتما دقت کنید که همهی User-agent ها در فایل Robots.txt به حروف کوچک و بزرگ (case sesitive) حساس هستند.

همچنین می توانید از (*) ستاره برای اختصاص دستورالعمل ها به همه ی User-agent ها استفاده کنید.

به عنوان مثال، شما میخواهید همه ربات ها بجز Googlebot را از خزیدن یا کراول سایت خود مسدود کنید. در اینجا نحوه انجام آن را می بینید:

باید بدانید که فایل Robots.txt میتواند دستور العمل ها را برای هر تعداد دلخواه User-agents در نظر بگیرد. به این صورت، هر بار که User-agent جدیدی را اعلام کنید، آنچه که مربوط به قبل بوده را در نظر نمیگیرد (مانند یک صفحه سفید عمل میکند). به عبارت دیگر اگر برای چندین User-agent دستورالعمل اضافه کنید، دستورالعمل های اعلام شده برای User-agent اول، در مورد دوم، یا سوم، یا چهارم و الی آخر اعمال نمیشود.

استثناء آن قانون در مواردی است که شما بیش از یک بار همان User-agent را اعلام میکند. در این حالت، همه ی دستورالعمل های مربوطه انجام و دنبال میشوند.

خوب است بدانید که خزنده ها فقط قوانینی که تحت عنوان (User-agents) اعلام شده و به طور دقیق در مورد آنها اعمال میشود را دنبال می کند. به همین دلیل فایل Robots.txt در بالا، همه ی ربات ها بجز Googlebot (و سایر ربات های گوگل) را از خزیدن سایت ممنوع کرده است. Googlebot اعلان آن User-agent که مرتبه کمتری دارد را رد میکند.

دستورالعمل های فایل ربات TXTدستورالعمل ها قوانین و قواعد برای User-agent ها هستند که شما می خواهید از این دستورالعمل ها پیروی کنند.

دستورالعمل های پشتیبانی شده

در اینجا دستورالعمل هایی که در حال حاضر گوگل از آنها پشتیبانی میکند، به همراه کاربردهای آن ها وجود دارد.

Disallow

از این دستور برای راهنمایی موتورهای جستجو استفاده می شود تا به فایل ها و صفحاتی که در یک مسیر خاص وجود دارند دسترسی پیدا نکنند. برای مثال، اگر می خواهید همه ی موتورهای جستجو را از دسترسی به وبلاگ و همه ی پست های آن مسدود کنید، فایل Robots.txt شما به این شکل باید باشد:

نکته: اگر نتوانید مسیری را بعد از دستور disallow تعیین کنید، موتورهای جستجو آن را نادیده میگیرند.

Allow

این دستور به به موتورهای جستجو اجازه میدهد تا یک زیرشاخه یا یک صفحه را کراول کنند، حتی فایل های غیرمجاز. برای مثال، اگر میخواهید از دسترسی موتورهای جستجو به هر پست در وبلاگ خود بجز یک مورد آن جلوگیری کنید، فایل Robots.txt شما به این گونه خواهد بود:

در این مثال، موتورهای جستجو به /blog/allowed-post دسترسی دارند. اما به این پست ها دسترسی ندارند:

/blog/another-post/blog/yet-another-post/blog/download-me.pdf

نکته ۱ : گوگل و Bing هر دو این دستور را پشتیبانی میکنند.

نکته ۲ : مانند دستور Disallow، اگر نتوانید مسیری را پس از دستور Allow تعریف کنید، موتورهای جستجو آنرا نادیده میگیرند.

باید بدانید که دستورهای Disallow و Allow به راحتی با یکدیگر تداخل ایجاد میکنند. در مثال زیر، ما دسترسی به /blog/ را ممنوع یا همان Disallow کردیم، و به /blog اجازه دسترسی (Allow) داده ایم.

در این مورد، بنظر میرسد آدرس /blog/post-title/ هم اجازه دسترسی (Allow) و هم عدم دسترسی (Disallow) دارد. پس کدام یک برنده است؟

برای گوگل و Bing، قاعده به این صورت است که دستوری که بیشترین تعداد کاراکتر را داشته باشد برنده می شود. در اینجا، دستور disallow برنده است.

Disallow: /blog/ ۶ کاراکتر

Allow: /blog ۵ کاراکتر

اگر طول دستورات allow و disallow یکسان بود، دستوری که کمترین محدودیت را دارد برنده است. در این حالت، دستور allow می باشد.

نکته: در اینجا، /blog (بدون / در انتهای آن) هم قابل دسترسی و قابل کروال شدن است.

نکته مهم: این موضوع فقط در مورد گوگل و Bing اتفاق می افتد. موتورهای جستجو دیگر به اولین دستور منطبق نگاه می کنند. پس در این حالت، دستور disallow میباشد.

Sitemap

با استفاده از این دستور مکان سایت مپ (sitemap) سایت خود را برای موتورهای جستجو مشخص کنید. (اگر درباره ی سایت مپ (sitemap) نمیدانید، آن شامل صفحاتی است که میخواهید موتورهای جستجو کراول و ایندکس کنند.)

در اینجا نمونه ای از فایل Robots.txt که از دستور سایت مپ (sitemap) استفاده کرده است را آورده ایم:

شاید برایتان سوال باشد که چقدر مهم است که در فایل Robots.txt نقشه سایت یا همان sitemap را درج کنیم؟

اگر قبلا sitemap خود را در سرچ کنسول ثبت کرده اید، تا حدودی کار اضافی برای گوگل انجام داده اید. با این حال، این کار به دیگر موتورهای جستجو مانند Bing میگوید که کجا سایت مپ شما را پیدا کنند. بنابراین هنوز هم عمل خوبی است.

توجه داشته باشید که نیازی نیست هر بار برای هر user-agent دستور سایت مپ را تکرار کنید. این دستور فقط برای یک مورد صدق نمیکند. بنابراین بهتر است دستور سایت مپ را در ابتدا یا پایان فایل Robots.txt قرار دهید. مثلا: گوگل، یاهو، Bing، Ask از این دستور پشتیبانی می کنند.

نکته: می توانید هر تعداد sitemap که بخواهید در فایل robots.txt خود داشته باشید.

دستورهای غیر قابل پشتیبانی

در این بخش دستورالعمل هایی که (بعضی از آنها از نظر فنی وجود ندارد) توسط گوگل دیگر پشتیبانی نمیشود را می بینیم.

Crawl-delay

پیش از این شما میتوانستید از این دستور برای مشخص کردن زمان تاخیر خزنده در ثانیه استفاده کنید. برای مثال، اگر میخواستید Googlebot پس از هر عمل خزیدن یا کراول ۵ ثانیه صبر کند، شما crawl-delay را روی ۵ مثل مثال زیر تنظیم میکردید:

گوگل دیگر از این دستور پشتیبانی نمیکند، اما Bing و Yandex این کار را انجام میدهند.

گفته میشود، هنگام تنظیم این دستورالعمل دقت کنید، به خصوص اگر سایت بزرگی دارید.

اگر crawl-delay را روی ۵ ثانیه تنظیم کنید، شما ربات ها را محدود کردید تا حداکثر ۱۷۲۸۰ آدرس اینترنتی را در یک روز کراول کنند. که این برای سایت هایی که میلیون ها صفحه داشته باشد، اصلا مفید نیست. اما در صورت داشتن یک وب سایت کوچک می توانید با این کار پهنای باند (bandwidth) را ذخیره کنید.

Noindex

این دستورالعمل هرگز توسط گوگل به طور رسمی پشتیبانی نمیشد. با این حال تا همین اواخر، تصور میشد که گوگل تعدادی “کد که برای قوانین پشتیبانی نشده و منتشر نشده (مثل noindex) بکار می رود” داشت.

بنابراین اگر میخواهید از ایندکس کردن همه ی پست های وبلاگ خود در گوگل جلوگیری کنید، میتوانید از این دستورالعمل استفاده کنید.

با این حال، در ۱ سپتامبر ۲۰۱۹، گوگل به طور واضح اعلام کرد که این دستورالعمل پشتیبانی نمیشود.

اگر میخواهید دسترسی یک صفحه یا فایل های خود را از موتورهای جستجو ببندید، به جای آن از meta robots tag یا x-robots HTTP header استفاده کنید.

Nofollow

دستور nofollow نیز دستور دیگری است که گوگل هیچ وقت به طور رسمی از آن پشتیبانی نکرده است. این دستور بدین منظور استفاده می شد که برای موتورهای جستجو تعیین میکرد که لینک های صفحات و فایل های مسیر مشخص شده را دنبال نکنند. به عنوان مثال، اگر میخواستید جلوی گوگل را از دنبال کردن همه ی لینک های موجود در وبلاگ خود را بگیرید، باید از دستور زیر استفاده میکردید:

گوگل در تاریخ ۱ سپتامبر ۲۰۱۹، اعلام کرد که این دستور به طور رسمی پشتیبانی نمیشود. اگر الان میخواهید همه ی لینک های یک صفحه را nofollow کنید، باید از robots meta tag یا x-robots header استفاده کنید. همچنین اگر می خواهید گوگل لینک خاصی را در یک صفحه دنبال نکند، باید از ویژگی rel=”nofollow” در تگ لینک خود استفاده کنید.

آیا به فایل robots.txt نیاز دارید؟داشتن فایل robots.txt برای بسیاری از وب سایت ها، به ویژه برای سایت های کوچکتر، خیلی مهم نیست.

در واقع، هیچ دلیل خوبی برای نداشتن فایل robots.txt وجود ندارد. این فایل به شما این امکان را میدهد تا کنترل بیشتری بر روی موتورهای جستجو داشته باشید، که به کدام قسمت از وب سایت شما وارد شوند یا وارد نشوند. و این موضوع میتواند در بعضی موارد به شما کمک کند مثل :

جلوگیری از کراول کردن محتوای تکراری خصوصی نگه داشتن بخش هایی از وب سایت (مثل مرحله بندی سایت) جلوگیری از کراول کردن صفحات نتایج جستجوی داخلی جلوگیری از ایجاد بار سنگین بر روی سرور جلوگیری گوگل از اتلاف “crawl budget” (جلوگیری از به هدر رفتن زمان سپری شده در هنگام بازدید وب سایت توسط ربات ها) جلوگیری از نمایش تصاویر، فیلم ها و فایل های منبع در نتایج جستجوی گوگل.توجه داشته باشید که اگر گوگل صفحاتی که در فایل robots.txt مسدوده شده است را ایندکس نمیکند، هیچ تضمینی برای ممنوع شدن از نتایج جستجو در فایل robots.txt وجود ندارد.

همانطور که گوگل میگوید، اگر محتوایی به دیگر مکان های از وب لینک داده شود، ممکن است همچنان در نتایج جستجوی گوگل ظاهر شود.

چگونه فایل robots.txt خود را پیدا کنیم؟اگر در حال حاضر یک فایل robots.txt در وب سایت خود دارید، در domain.com/robots.txt قابل دسترسی خواهد بود. در مرورگر خود به این آدرس بروید. اگر چیزی شبیه این را می بینید، پس فایل robots.txt دارید.

نحوه ایجاد فایل robots.txtاگر در حال حاضر فایل robots.txt ندارید، ایجاد آن کار آسانی است. برای شروع کافی است که یک سند خالی با فرمت .txt را باز کنید و تایپ دستورالعمل ها را شروع کنید. به عنوان مثال، اگر می خواهید دسترسی همه ی موتورهای جستجو را از خزیدن یا کراول کردن دایرکتوری /admin/ ببندید، چیزی شبیه به این را خواهید داشت:

به این کار ادامه دهید، تا زمانی که تمام دستوراتی که میخواستید را نوشته باشید. سپس فایل خود را با نام “robots.txt” ذخیره کنید.

از طرف دیگر شما می توانید از یک ابزار robots.txt generator مثل این استفاده کنید.

مزیت استفاده از این نوع ابزارها این است که خطاهای نوشتاری (syntax) را به حداقل می رساند. این مزیت خوبی است به این خاطر که یک اشتباه می تواند منجر به ایجاد مشکل برای سئو وب سایت شما شود. بنابراین باید خطرات احتمالی را بپذیرید.

نقطه ضعف این ابزار ایجاد محدودیت از نظر شخصی سازی می باشد.

فایل robots.txt را باید در کجا قرار دهیم؟فایل robots.txt خود را در زیر دامنه ی (subdomain) دایرکتوری اصلی (root directory) باید قرار دهید. به عنوان مثال برای کنترل رفتار کراولر یا خزنده در domain.com فایل robots.txt باید در آدرس domain.com/robots.txt در دسترس باشد.

اگر می خواهید خزیدن یا کراول کردن روی یک ساب دامین مانند blog.domain.com را کنترل کنید، باید فایل robots.txt در blog.domain.com/robots.txt در دسترس باشد.

بهترین روش های Robots.txt

این موارد را به خاطر داشته باشید تا از اشتباهات رایج خودداری کنید.

برای هر دستور یک خط در نظر بگیرید

هر دستور باید در یک خط جدید قرار گیرد. در غیر این صورت، موتورهای جستجو را دچار سردرگمی میکند.

نمونه اشتباه:

نمونه صحیح:

استفاده از wildcards برای ساده کردن دستورالعمل ها

نه تنها می توانید از وایلد کارد (*) برای اعمال دستورها برای همه ی user-agent ها استفاده کنید، بلکه برای آدرس هایی که والد یکسان دارند و می توان آنها را باهم تطبیق داد به هنگام اعلام دستور استفاده کنید. برای مثال، اگر شما می خواهید از دسترسی موتورهای جستجو به آدرس های طبقه بندی شده ی محصول در سایت خود جلوگیری کنید، می توانید این موارد را به این طریق لیست کنید:

اما این کار خیلی کارآمد نیست. بهتر است با استفاده از وایلدکارد (wildcard) کار را ساده تر کنید. مانند زیر:

این مثال موتورهای جستجو را از کراول کردن همه ی آدرس هایی که در پوشه ی زیر /product/ قرار دارد و حاوی یک علامت سوال هستند را جلوگیری می کند. به عبارت دیگر، هر آدرس پارامتری کتگوری محصول.

استفاده از “$” برای مشخص کردن پایان URL

نماد “$” را پایان URL بنویسید تا انتهای آدرس مشخص شود. به عنوان مثال، اگر می خواهید موتورهای جستجو به تمام فایل های .pdf سایت شما دسترسی نداشته باشند، فایل robots.txt شما باید این گونه باشد:

در این مثال، موتورهای جستجو نمی توانند به آدرس هایی که به .pdf ختم می شوند، دسترسی داشته باشند. این بدین معنی است که آنها به /file.pdf دسترسی ندارند، اما می توانند به /file.pdf?id=68937586 دسترسی پیدا کنند. به این دلیل که این آدرس به “.pdf” ختم نمی شود.

از هر user-agent فقط یک بار استفاده کنید

اگر یک user-agent را چندین بار استفاده کنید، گوگل توجهی نمی کند. گوگل صرفا همه ی دستورات و قوانین از اعلان های مختلف را در یکی ترکیب می کند و همه ی آنها را دنبال می کند. برای مثال، اگر در فایل robots.txt خود user-agents و دستورات زیر را دارید…

…Googlebot نمی تواند هیچ یک از این پوشه ها را کراول کند.

با توجه به این گفته، کاملا معقول است که هر user-agent را فقط یکبار صدا کنیم زیرا کمتر باعث سردرگمی می شود. به عبارت دیگر، اگر دستورات را مرتب و تمیز بنویسید، احتمال اینکه اشتباهی رخ دهد بسیار کمتر است.

استفاده از دستورات مشخص برای جلوگیری از خطاهای غیر عمدی

عدم استفاده از دستورالعمل های مشخص و صحیح به هنگام تنظیم دستورات می تواند منجر به اشتباهاتی شود به راحتی باعث تاثیر فاجعه آمیزی بر سئوی سایت شما داشته باشند. به عنوان مثال، فرض می کنیم که شما یک سایت چند زبانه دارید و در حال حاضر دارید روی نسخه زبان آلمانی کار می کنید که تحت زیر دایرکتوری /de/ قرار دارد.

از آنجا که هنوز کاملا آماد نیست، شما می خواهید که از دسترسی موتورهای جستجو جلوگیری کنید.

فایل robots.txt زیر مانع دسترسی موتورهای جستجو به آن پوشه و همه ی موارد داخل آن می شود:

اما مانع از خزیدن یا کراول کردن موتورهای جستجو در صفحات و یا فایل هایی که با /de شروع می شوند نیز می شود.

برای مثال:

/designer-dresses/

/delivery-information.html

/Depeche-mode/t-shirts/

/definitely-not-for-public-viewing.pdf

در این مثال، راه حل بسیار ساده است: در انتها یک اسلش اضافه کنید.

استفاده از کامنت در فایل robots.txt برای توضیحات بیشتر به انسان

گذاشتن کامنت به توسعه دهندگان (developers) کمک می کند تا دستورات فایل robots.txt برای آنها واضح و مشخص باشد. حتی این کامنت ها در آینده می توان برای خود شما نیز کمک کننده باشد.

برای درج کامنت باید ابتدای آن را با یک (#) شروع کنید.

کراولر ها یا خزنده ها هر آنچه در نوشته هایی که با # شروع شده باشند را نادیده می گیرد.

استفاده از یک فایل robots.txt جداگانه برای هر زیر دامنه (subdomain)

Robots.txt رفتار کراولر یا خزنده در هر زیر دامنه (subdomain) را فقط وقتی خودش میزبان باشد کنترل می کند. اگر می خواهید رفتار کراولر روی هر زیر دامنه (subdomain) را کنترل کنید، برای هر کدام یک فایل robots.txt جداگانه نیاز دارید.

به عنوان مثال، اگر سایت اصلی شما در domain.com و وبلاگ شما در bolg.domain.com قرار دارد، پس شما به دوتا فایل robots.txt احتیاج دارید. یکی از آنها باید در دایرکتوری root از دامنه اصلی قرار بگیرد و دیگری دایرکتوری root وبلاگ قرار بگیرد.

مثال هایی از robots.txt

در زیر چند نمونه از فایل های robots.txt آورده شده است. این نمونه ها عمدتا برای الگو گرفتن است اما اگر اتفاقی یکی از این نمونه ها با آن چیزی که شما نیاز دارید مطابقت داشت، می توانید آن را در یک فایل متنی (text document) گپی کنید و آن را با نام “robots.txt” ذخیره کنید و در آخر در دایرکتوری مناسب بارگذاری کنید.

دسترسی همه جانبه برای همه ی ربات ها

نکته: عدم اعلام یک URL پس از یک دستورالعمل، مانع اجرای این دستور می شود یا به اصطلاح از کار می اندازد. به عبارت دیگر موتورهای جستجو آن را نادیده می گیرند. به همین دلیل این دستور disallow هیچ تاثیری در سایت ندارد. موتورهای جستجو هنوز می تواند همه صفحات و فایل ها را کراول کنند.

عدم دسترسی به همه ربات ها

مسدود کردن یک ساب دایرکتوری برای همه ربات ها

مسدود کردن یک ساب دایرکتوری برای همه ربات ها (بجز یک فایل)

مسدود کردن یک فایل برای همه ربات ها

مسدود کردن یک نوع فایل (مثل PDF) برای همه ربات ها

مسدود کردن URL هایی پارامتری فقط برای Googlebot

چگونگی بررسی و رسیدگی مشکلات بوجود آمده Robots.txt

اشتباهات robots.txt می تواند به راحتی درون اینترنت منتشر شود، بنابراین باید حواسمان کاملا به این مسائل باشد.

برای این کار، مرتبا باید موارد مربوط به robots.txt را در قسمت گزارش “Coverage” سرچ کنسول بررسی کنید. در زیر برخی از خطاهایی که ممکن است مشاهده کنید، منظور آنها و نحوه ی رفع آنها آورده شده است.

آیا نیاز به بررسی خطاهای مربوط به یک صفحه خاص را دارید؟

آدرس موردنظر خود را در ابزار Google`s URL Inspection در سرچ کنسول وارد کنید. اگر توسط robots.txt مسدود شده است، باید چیزی شبیه به این را مشاهده کنید:

مسدود شدن URL های ثبت شده توسط robots.txt

این بدین معنی است که حداقل یکی از آدرس های ثبت شده در sitemap توسط robots.txt مسدود شده است.

اگر Sitemap خود را به درستی ایجاد کرده اید و صفحات ریدایرکت شده، noindexed و کنونیکال را مسثتنی قرار داده اید، هیچ یک از صفحات ثبت شده نباید توسط robots.txt مسدود شود. اگر هم وجود دارد، بررسی کنید که کدام صفحات اثر گذاشته است، سپس فایل robots.txt خود را مطابق با آن تنظیم کنید تا آن صفحه از بلاک خارج شود.

شما می توانید از Google`s robots.txt tester استفاده کنید تا ببینید کدام دستور محتوا را مسدود کرده است. فقط در هنگام انجام این کار مراقب باشید. ممکن است به راحتی اشتباهی صورت بگیرد و این باعث اثر گذاشتن روی دیگر صفحات و فایل ها شود.

بلاک شده توسط robots.txt

این بدین معنی است که شما محتوایی دارید که توسط robots.txt مسدود شده است که در حال حاضر در گوگل ایندکس نمی شوند.

اگر این محتوا مهم است و باید ایندکس شود، مسدود سازی خزنده یا کراولر را از robots.txt حذف کنید. (همچنین لازم است اطمنیان حاصل کنید که محتوا noindexed نباشد). اگر شما محتوا را در robots.txt با قصد جلوگیری از ایندکس شدن در گوگل مسدود کرده اید، باید از بلاک خارج کرده و به جای آن از robots meta tag یا x-robots-header استفاده کنید. این تنها راهی است که تضمین می کند گوگل این محتوا را ایندکس نمی کند.

نکته: حذف مسدود سازی خزنده یا کراولر وقتی قصد خارج کردن یک صفحه از نتایج گوگل را دارید بسیار مهم است. اگر این کار را انجام ندهید و گوگل تگ noindex یا HTTP header را مشاهده نکند، در این صورت همچنان ایندکس باقی خواهد ماند.

اگر چه توسط robots.txt بلاک شده ولی ایندکس شده

این بدین معنی است که برخی از محتواهایی که توسط robots.txt مسدود شده اند هنوز در گوگل ایندکس می شوند.

یک بار دیگر، اگر می خواهید این محتوا را از نتایج جستجوی گوگل حذف کنید، robots.txt راه حل مناسب و درستی نیست. شما باید مسدود سازی کراولر را برداشته و در عوض از meta robots tag یا x-robots-tag HTTP header استفاده کنید تا از ایندکس کردن جلوگیری کند.

اگر اشتباهی این محتوا را بلاک کرده اید و می خواهید در گوگل ایندکس شود، مسدود سازی کراولر را در robots.txt حذف کنید. این کار کمک می کند تا محتوای شما در نتایج گوگل دیده شود.

پرسش و پاسخ سوالات احتمالی درباره فایل رباتدر اینجا چند سوال متداولی وجود دارد که در مباحث بالا قرار نداشته است. اگر سوالی دارید که در مطالب بالا گفته نشده برای من کامنت بگذارید تا این بخش را بروز کنم.

حداکثر اندازه ی یک فایل robots.txt چقدر است؟تقریبا ۵۰۰ کیلوبایت

فایل robots.txt در وردپرس کجاست؟در همان مکانی که گفته شد: domain.com/robots.txt

چگونه فایل robots.txt را در وردپرس ویرایش کنم؟یا به صورت دستی، یا با استفاده از پلاگین های موجود مثل Yoast یوآست که به شما این امکان را می دهد از بخش بک اند وردپرس فایل robots.txt را ویرایش کنید.

چه اتفاقی می افتاد اگر دسترسی به محتوای noindexed را در فایل robots.txt، ببندیم (disallow) ؟گوگل هرگز دستور noindex را نمیبیند چون نمی تواند صفحه را کراول کند.

نتیجه نهایی

فایل robots.txt یک فایل ساده ولی در عین حال قدرتمنداست. از آن هوشمندانه استفاده کنید، تا تاثیر مثبتی بر سئو داشته باشد.